Autore:AXYZ DESIGN

Data:2023-09-20

ESPLORARE L’IMPATTO DELL’INTELLIGENZA ARTIFICIALE

L’AI STA CAMBIANDO I FLUSSI DI LAVORO DELLA VISUALIZZAZIONE ARCHITETTONICA?

INTERVISTA A FRANCESCO TESTA DI PROMPT

Immagine realizzata da Prompt studio, utilizzando Midjourney AI.

Ogni giorno assistiamo a notevoli progressi nel campo dell’intelligenza artificiale, con soluzioni sempre più impressionanti che a volte suscitano ammirazione e, a volte, suscitano preoccupazioni.

In AXYZ, come sviluppatori di software, e tu, nel tuo ruolo di artisti, è naturale chiedersi come possiamo sfruttare al meglio queste nuove tecnologie. In che modo potrebbero arricchire le nostre attività quotidiane? Queste tecnologie potrebbero contribuire a valorizzare le nostre immagini e i nostri prodotti? E in definitiva, sono accessibili a tutti?

Per fare luce su queste domande, abbiamo avuto il privilegio di intervistare Francesco Testa, fondatore e mente creativa dello studio catalano Prompt. Questo studio creativo è ampiamente riconosciuto per la sua capacità di dare vita a progetti architettonici attraverso accattivanti visualizzazioni, animazioni ed esperienze di tour virtuale a 360°.

Prima di procedere, permettetemi di esprimere la nostra sincera gratitudine per averci fornito la preziosa opportunità di approfondire i progetti e il lavoro svolto presso il vostro studio. Inoltre, siamo lieti che tu abbia accettato di partecipare a questa breve intervista.

- L’anno scorso l’argomento di conversazione predominante era il Metaverso, ma un anno dopo sembra che l’Intelligenza Artificiale (AI) abbia preso il centro della scena. Ritieni che si tratti di un fenomeno passeggero o di una vera e propria tendenza?

È perfettamente comprensibile fare un paragone tra il Metaverso e l'intelligenza artificiale, poiché entrambi hanno ricevuto un'attenzione e una copertura significative da parte dei media. Crediamo però che si tratti di due concetti diametralmente opposti, ed è qui che risiede, almeno per ora, la longevità dell'uno rispetto all'altro. Il Metaverso è un concetto che trasforma il nostro spazio fisico in digitale, creando la sensazione di colmare le distanze e tentando di umanizzare le relazioni digitali attraverso proiezioni "ottimistiche" di noi stessi, note come avatar. La necessità di creare questo nuovo mondo digitale è stata fortemente alimentata dal senso di isolamento provocato dalla pandemia di COVID-19, guidato da significativi interessi economici che cercano di replicare i “bisogni” del mondo reale esistenti nel regno digitale. Con sorpresa di molti, privati e aziende, la reazione predominante dopo la pandemia è stata quella di tornare al contatto umano, fisico e di godere nuovamente degli spazi naturali che in quel periodo erano stati ristretti, piuttosto che immergersi in un mondo digitale osservato attraverso gli occhiali. Ciò segnò l'inizio del declino del Metaverso. Le grandi aziende hanno dovuto assorbire perdite multimilionarie negli investimenti legati a Metaverse, e sul concetto stesso è sorto scetticismo al punto che il principale promotore è stato costretto a metterlo a tacere. Proprio in quel momento, quasi senza preavviso, l'intelligenza artificiale emerse e relegò il Metaverso nell'oblio. L’intelligenza artificiale è nata come risultato di molti anni di ricerca e, per ragioni che non possiamo ancora classificare come positive o negative, è diventata accessibile al grande pubblico già nella sua fase di sviluppo, generando un’enorme quantità di dati che ha portato a una crescita esponenziale. Una differenza significativa tra l’intelligenza artificiale e il Metaverso è che, nonostante alcune grandi aziende attribuiscano ad essa il loro successo, il fondamento dell’intelligenza artificiale è open source, consentendo a chiunque di utilizzare liberamente diversi modelli di intelligenza artificiale. Questa stessa caratteristica consente inoltre agli utenti di migliorare e creare nuovi modelli, fornendo una velocità e una libertà che il Metaverso non ha mai avuto.

In altre parole, se il Metaverso dovesse continuare a svilupparsi, probabilmente si affiderebbe agli strumenti di intelligenza artificiale. In sostanza, la base tecnologica di gran parte del nuovo software sarà creata e supportata dall’intelligenza artificiale. Non crediamo che si tratti di una moda passeggera; piuttosto, è arrivato per restare. Può essere paragonata a ciò che la rivoluzione industriale rappresentò per il mondo a suo tempo. Attualmente abbiamo l’opportunità di sperimentare la rivoluzione tecnologica, che probabilmente cambierà il nostro modo di vivere. In brevissimo tempo sono stati compiuti progressi significativi in vari campi come la medicina, la fisica, l’istruzione, ecc., generando numerose domande legate all’occupazione, all’economia e all’etica.

- Avete condotto test specifici utilizzando queste nuove tecnologie?

Sì, spinti soprattutto dalla curiosità e dalla necessità di capire come questi nuovi strumenti potessero aiutarci nel nostro lavoro, abbiamo iniziato quasi subito ad utilizzare Dall-e per creare ricostruzioni di parti di città in immagini fisse. Questo era un compito che ci avrebbe richiesto molto più tempo in Photoshop. Poco dopo è emerso Midjourney e abbiamo iniziato a utilizzarlo per realizzare visualizzazioni iniziali delle idee dei nostri clienti. Queste immagini ci hanno aiutato a guidarci nella direzione che ogni immagine dovrebbe prendere. Abbiamo anche iniziato a sviluppare brevi introduzioni alle animazioni per alcuni progetti in Midjourney utilizzando immagini fisse, che abbiamo poi animato in After Effects. Parallelamente, abbiamo continuato ad imparare come utilizzare, attraverso prove ed errori, lo strumento che è senza dubbio il più potente per il nostro tipo di lavoro: Stable Diffusion. Con esso, siamo passati dagli esperimenti di animazione all'apporto di correzioni complesse alle immagini fisse, al miglioramento delle texture, all'aggiunta di dettagli organici alle immagini e persino alla creazione di personaggi ancora più realistici basati sulle risorse AXYZ anima® PRO / ALL 3D e 4D people. Abbiamo anche utilizzato modelli di generazione vocale per creare bozze iniziali di animazione con voci fuori campo, permettendoci di perfezionarle alla perfezione con il cliente e lo sceneggiatore prima di assumere un doppiatore professionista.

- Che tipo di risultati hai ottenuto finora? Si tratta di risultati puramente sperimentali, oppure hai avuto modo di applicarli in progetti o servizi specifici?

Poiché questi strumenti sono in continua evoluzione, non ci sono ancora molte informazioni su come utilizzarli in modo efficace, quindi sono necessari molti tentativi ed errori. Grazie al fatto che una parte dello studio era ancora coinvolta nella produzione dei progetti in corso, un'altra parte ha potuto dedicare del tempo alla ricerca. Ora abbiamo raggiunto un punto in cui possiamo condividere e implementare questo apprendimento in tutto lo studio. Tuttavia, siamo rimasti piacevolmente sorpresi dalla rapidità con cui siamo riusciti a integrare questi strumenti di intelligenza artificiale in progetti reali. Sappiamo tutti che nel nostro settore spesso lavoriamo con scadenze ravvicinate e non c'è molto spazio per gli errori, per non parlare della sperimentazione. È qui che risiede l’importanza di questi nuovi strumenti, poiché semplificano i processi e ci forniscono idee e soluzioni che forse non avremmo mai preso in considerazione prima, il tutto a una velocità impressionante.

Tuttavia, non è stato privo di sfide. Ad esempio, abbiamo creato un video che incorporava un nuovo approccio narrativo per l'introduzione di un progetto, ma il cliente ci ha chiesto di eliminare l'intera introduzione generata utilizzando le immagini di Midjourney. Erano riluttanti a mostrare immagini dall'aspetto così artificiale e, alla fine, non siamo riusciti a determinare se si trattasse di una preferenza personale o semplicemente di una mancanza di comprensione dello strumento e delle sue capacità. Abbiamo dovuto sostituire tutte le immagini di qualità FullHD che avevamo creato con video stock pixelati. Ecco perché comprendiamo che tutto questo fa parte di un processo, sia in termini di insegnamento che di apprendimento, simile a come AutoCAD ha incontrato inizialmente resistenze nel mondo del disegno architettonico 2D. All'inizio molte persone erano contrarie al disegno assistito dal computer, ma ora, più di 20 anni dopo, è uno degli strumenti di disegno più popolari.

- Potresti parlarci di uno di loro?

Recentemente, uno dei nostri clienti stava sviluppando un progetto su un'isola nel Mar Rosso e voleva che il video di presentazione del progetto non fosse solo architettonico; volevano che avesse una forte componente narrativa. Ci hanno scritto:

Per l'introduzione del video, dobbiamo raccontare la storia dei pellegrini durante la migrazione (hijrah 620 d.C.) che, mentre attraversavano il Mar Rosso sui loro caratteristici Dhow (barche), naufragarono su un'isola praticamente deserta. Il poco legno che riescono a recuperare dalle barche viene utilizzato per bruciare e creare segnali di fumo, ma non vengono mai salvati, così decidono di stabilirsi sull'isola, sviluppando un'architettura basata su coralli, alghe, stucchi e tronchi piramidali forme. Dopo alcuni anni, l'unica sorgente dell'isola si secca e con essa la piccola civiltà scompare, lasciando solo i resti di questa architettura unica. Dobbiamo creare una transizione interessante per trasmettere che sono passati 1400 anni e siamo ai giorni nostri, vedendo la nostra proposta di progetto, che incorpora molte caratteristiche dell'architettura dell'isola.

Il tutto un mese prima della scadenza, producendo 16 immagini e un'animazione 3D di 2 minuti del progetto stesso... Un anno fa la risposta sarebbe stata: "È impossibile farlo, altrimenti costerà in proporzione tanto quanto realizzare 'Avatar: The Sense of Water.'" Ma fortunatamente siamo riusciti a fornire una soluzione praticabile. Per prima cosa abbiamo creato una chat specifica in GPT-4 sul periodo dell'Egira, chiedendo come potevano vestirsi i pellegrini, le loro usanze, come erano i loro dhow, quali strumenti usavano e così via. Abbiamo raccolto molte informazioni che ci avrebbero aiutato a creare una rappresentazione immaginaria di quel periodo. Quindi, abbiamo copiato e incollato le istruzioni di Midjourney sui suggerimenti di testo da utilizzare per generare le immagini. Abbiamo anche fornito a GPT-4 diversi esempi di prompt che hanno generato immagini fotorealistiche. Con tutte queste informazioni, abbiamo iniziato a chiedere a GPT-4 di scrivere istruzioni per generare immagini per ciascuna parte dello script fornito dal nostro cliente. In questo modo, abbiamo creato una narrazione per immagini, generando letteralmente centinaia di immagini prima di trovarne una che funzionasse bene e, gradualmente, la narrazione ha preso forma. Successivamente, abbiamo apportato alcune modifiche alle immagini con Photoshop Beta (utilizzando anche i suoi nuovi strumenti AI) e in After Effects abbiamo animato alcuni elementi e aggiunto un effetto di parallasse. Con la musica, il suono e alcuni altri effetti siamo riusciti a ottenere una forte componente narrativa, proprio come desiderava il cliente.

- Qual è la tua visione per il futuro? Come credi che questi strumenti stiano trasformando o trasformeranno il lavoro di un artista, se non lo hanno già fatto?

Crediamo fermamente che gli artisti non debbano sentirsi minacciati da questa tecnologia. Il loro ruolo, non come artigiani ma come artisti, dovrebbe essere quello di creare oltre gli strumenti, per discernere quale delle 100 immagini generate in pochi minuti è quella giusta, quella che funziona con le altre. Gli artisti dovrebbero avere la capacità di abbracciare la quantità; la quantità è diventata solo un altro elemento del processo creativo. Dimentichiamo il dibattito tra "quantità vs. qualità". Perdiamo la paura che il nostro stile ci appartenga e che questa tecnologia lo rubi affinché altri lo usino senza senso. Ci viene offerto un mondo infinito di stili che creeranno altri stili e ricordiamoci che questo è probabilmente il modo in cui siamo arrivati al nostro stile in primo luogo. Siamo specialisti in strumenti per la creazione di immagini e questo è solo uno strumento in più. Diventiamo esperti in questo strumento e non avremo paura di perdere clienti, perché non saranno esperti e scalfiranno solo la superficie di questo strumento. In un certo senso, l’intelligenza artificiale sta democratizzando gran parte del mondo artistico che in precedenza era riservato a grandi produzioni con attori, set, telecamere, ecc. Ora, con una scheda grafica decente, fantasia e ingegno, una sola persona può ottenere risultati piuttosto buoni. risultati. E questa è proprio la capacità di riprodurre/imitare una forma di linguaggio esistente. La vera sfida per gli artisti è trovare un nuovo linguaggio completamente autentico per l’intelligenza artificiale. Questa dovrebbe essere la nostra unica preoccupazione. Tutto ciò sta certamente trasformando e continuerà a trasformare il modo in cui lavoriamo. L’importante è comprendere, dal punto di vista professionale, le potenzialità di ciò che possiamo realizzare con questi strumenti. Vediamo che le potenti IA grafiche hanno già rivoluzionato il modo in cui presentiamo i contenuti digitali. Basta uno sguardo a una qualsiasi delle piattaforme di social media per vedere come i contenuti digitali vengano sempre più creati con l’intelligenza artificiale.

- Oggi vediamo già strumenti di fotoritocco che applicano soluzioni di intelligenza artificiale a specifiche applicazioni di intelligenza artificiale. Credi che in futuro questa tecnologia possa essere applicata ai software di rendering? Quali caratteristiche o capacità rivoluzionarie puoi immaginare che questa fusione possa offrire nel software di rendering?

Data la velocità con cui questa tecnologia si è sviluppata nell'ultimo anno, riteniamo che sia solo questione di tempo prima che funzioni efficacemente nei software di rendering. Ricorda, non si tratta solo dell'output visivo/grafico che l'intelligenza artificiale può generare, ma anche della sua capacità di apprendere e automigliorarsi man mano che viene utilizzata e riceve feedback in base alle sue prestazioni. Ad esempio, un motore di rendering potrebbe migliorare significativamente i tempi di rendering se eseguisse lo stesso rendering più volte con piccole modifiche nelle impostazioni e registrasse i risultati per ripeterli in situazioni simili. Inoltre, esiste un aspetto fondamentale delle immagini generate dall’intelligenza artificiale, ovvero che ogni generazione è governata da un parametro casuale chiamato “seme”, che può essere fissato (per replicare i risultati) o mantenuto casuale. Questa modalità casuale può generare idee (per l'inquadratura, l'illuminazione, le texture, la modellazione) a cui l'artista non avrebbe mai pensato. Se si presta particolare attenzione si possono ottenere risultati davvero sorprendenti. Non sarebbe irragionevole pensare che, ad un certo punto, il software di rendering possa implementare questa funzionalità al servizio della creatività dell'artista. Certamente non solo migliorerà il software di rendering, ma rivoluzionerà anche la modellazione 3D. Fino ad ora, la modellazione 3D ha rappresentato una parte della creazione digitale che richiedeva molto tempo. Immagina per un momento se gli oggetti 3D potessero essere disegnati utilizzando i prompt. Soprattutto nel caso della modellazione architettonica, i valori con cui lavoriamo sono interamente geometrici e matematici, nel senso che sono misurabili e precisi. Questi valori possono probabilmente essere inseriti tramite prompt in una piattaforma AI. Ciò ci consentirebbe di meccanizzare noiosi processi ripetitivi. Per fare un esempio, sarebbe come avere a portata di mano un assistente virtuale per il disegno 3D.

- Osserviamo che la maggior parte degli strumenti di intelligenza artificiale funzionano principalmente tramite istruzioni di testo. Tuttavia, poiché siete artisti grafici, gli input naturali non sarebbero immagini, tratti o moodboard? Qual è il tuo punto di vista su questo approccio?

In realtà, la stragrande maggioranza delle IA che generano immagini hanno integrato la capacità di ricevere input visivi. Infatti, per il nostro lavoro, è fondamentale disporre di queste estensioni/opzioni fornite da diverse piattaforme. Il più versatile e potente di tutti (anche se meno facile da usare) è Stable Diffusion, a cui si possono aggiungere diverse estensioni estremamente utili:

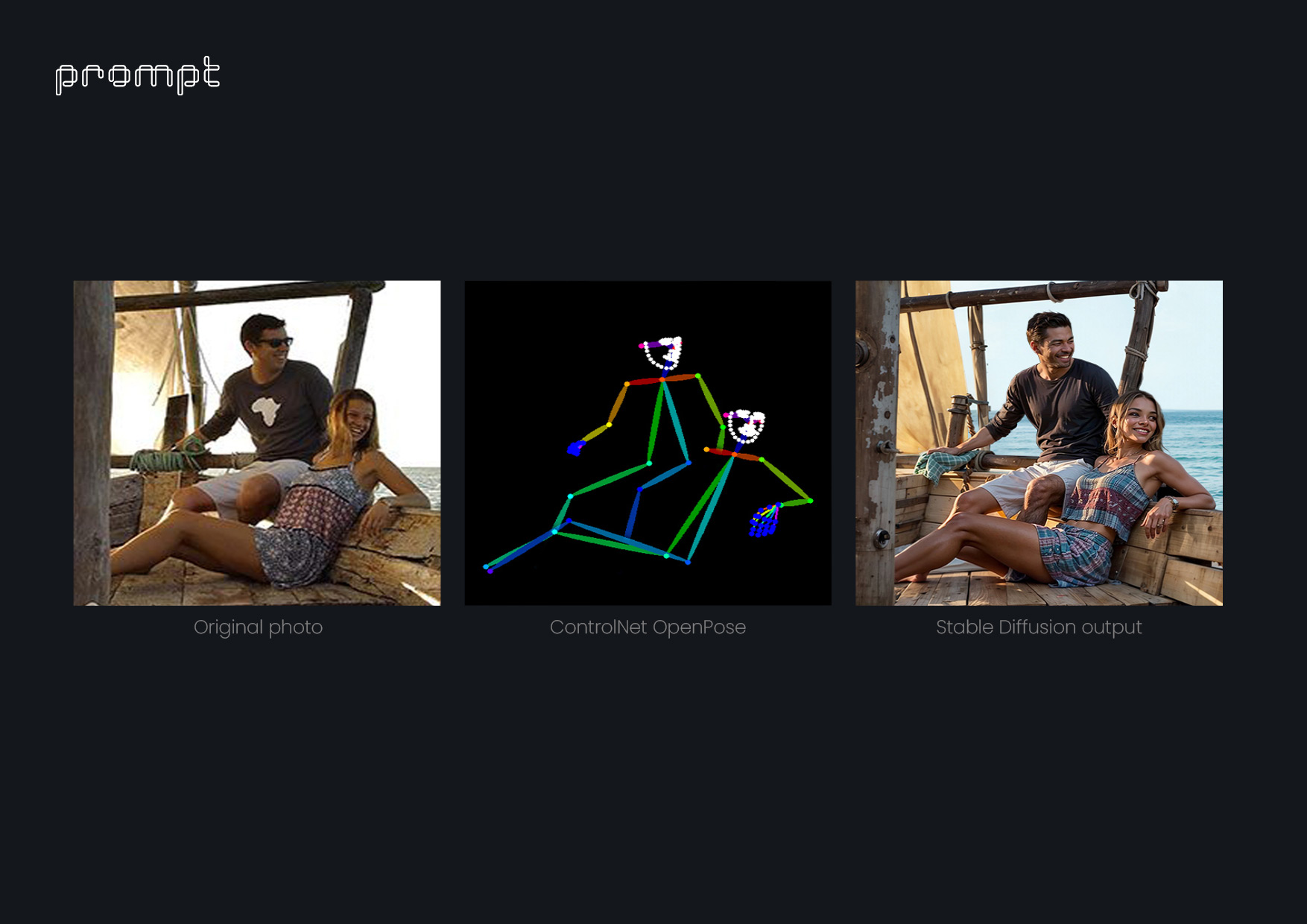

ControlNet:

È un'estensione che analizza un'immagine fornita dall'utente e dispone di diverse modalità di rilevamento. Una volta rilevato l'elemento desiderato dall'utente, è possibile istruirlo tramite istruzioni di testo a modificare solo quella parte selezionata. Per esempio:

- La "modalità OpenPose" ci consente di determinare la posizione delle figure umane nelle immagini (corpo, mani, volti, ecc.). Con questa modalità, possiamo rilevare la posizione di un personaggio AXYZ anima® PRO / ALL 3D e 4D people già integrato in una scena. Mantenendo l'angolazione e l'illuminazione della telecamera, possiamo creare variazioni ancora più realistiche dello stesso personaggio, che possono poi essere ulteriormente composte in Photoshop.

- La "modalità riferimento" viene utilizzata per copiare lo stile di un'immagine e applicarlo a un'altra.

- La "modalità Profondità" serve a rilevare i volumi nello spazio di un'immagine e quindi a riprodurli in un'altra immagine.

- La "modalità Hed" rileva piccoli dettagli che determinano i contorni di diversi elementi in un'immagine. Questa è una delle estensioni più potenti ed è in continua evoluzione grazie al contributo degli utenti.

Upscaler SD Ultimate:

Questa estensione viene utilizzata per ridimensionare, ricostruire e aggiungere dettagli alle immagini a bassa risoluzione. Tutti abbiamo riscontrato situazioni in cui un cliente richiede una texture molto specifica e ci invia una foto di 75x75 px ma vuole che quella texture copra l'80% di un'immagine da 4000 px. In precedenza, avremmo passato ore a cercare di replicare quella trama. Ora, grazie a questa estensione, possiamo utilizzare esattamente la stessa texture desiderata dal cliente senza perdere la qualità.

Inpaint:

Permette di disegnare su un'immagine solo ciò che vogliamo modificare con un messaggio di testo.

Outpaint:

Dalla stessa immagine, genera contenuto oltre i confini della cornice dell'immagine originale. Queste sono solo alcune delle estensioni a disposizione degli utenti per creare immagini basate esclusivamente su input visivi. La cosa meravigliosa di tutto questo è che lo sviluppo di questi strumenti, essendo open source, dipende dal contributo degli utenti e degli sviluppatori e non esclusivamente da un'azienda motivata esclusivamente da interessi economici.

- Guardando al futuro, come immagini una potenziale evoluzione del lavoro in cui sei attualmente impegnato?

Attualmente sono stati fatti passi da gigante nella generazione di immagini statiche. Tuttavia, la sfida significativa risiede nell’animazione. Fino a questo punto, il funzionamento intrinseco dei vari sistemi di intelligenza artificiale prevede la generazione di un frame alla volta, che viene interpretato come indipendente. Ciò può provocare una certa instabilità o mancanza di coerenza tra i fotogrammi, facendo sì che l'intera immagine appaia un po' "tremolante" durante la riproduzione. È probabile che questa instabilità si risolverà nel tempo. Tuttavia, come accennato in precedenza, la prospettiva più intrigante è lo sviluppo di un linguaggio visivo che non si limiti a imitare ciò che già facciamo, ma abbracci invece queste incongruenze e instabilità visive, considerandole non come errori ma come virtù. Le nostre aspirazioni per il prossimo futuro sono radicate nella ricerca di questa nuova modalità di espressione.

- In conclusione, vorrei chiederti, dal tuo punto di vista di utente e artista, come immagini una versione futura del nostro prodotto di punta, anima® PRO / ALL?

Se possiamo permetterci di pensare oltre le complessità tecniche, potremmo immaginare una versione futura di anima® PRO / ALL in cui sfrutta il suo ampio database di movimenti umani e input visivi provenienti da individui (etnie, abbigliamento, situazioni) e li interpreta utilizzando strumenti simili a OpenPose. Questa futura anima® consentirebbe agli utenti di inserire (o selezionare da un elenco limitato) un movimento e una descrizione fisica di un personaggio, quindi genererebbe una mesh 3D coerente da integrare nella scena. Ciò fornirebbe agli utenti un'incredibile libertà creativa e renderebbe ogni progetto, sia esso immagini statiche o animazioni, davvero unico. Comprendiamo che siamo ancora lontani dallo sviluppo di qualcosa di simile, ma considerando tutto ciò a cui abbiamo assistito in un solo anno nel campo dell'intelligenza artificiale, non saremmo sorpresi se diventasse realizzabile nel prossimo futuro. Pur essendo entusiasti e promotori dello sviluppo dell’intelligenza artificiale, siamo anche preoccupati per il potenziale uso improprio di questi strumenti, usi che si discostano dallo strumento stesso ma sono comunque pericolosi. È nostra responsabilità ricercare e continuare a sviluppare l’intelligenza artificiale, ma allo stesso tempo dobbiamo dedicare tempo per comprendere le implicazioni sociali che comporta ed essere pronti ad adattarci a un mondo in cui questa tecnologia gioca un ruolo fondamentale. Molte delle cose di cui abbiamo discusso in questa intervista si basano sulle nostre esperienze nell'uso dell'intelligenza artificiale nel nostro lavoro. È possibile che ci sbagliamo in alcune nostre riflessioni o che abbiamo menzionato alcuni processi in modo un po' superficiale. Pertanto, siamo completamente aperti ad avere una conversazione su questi argomenti o ad affrontare qualsiasi domanda che possa sorgere.

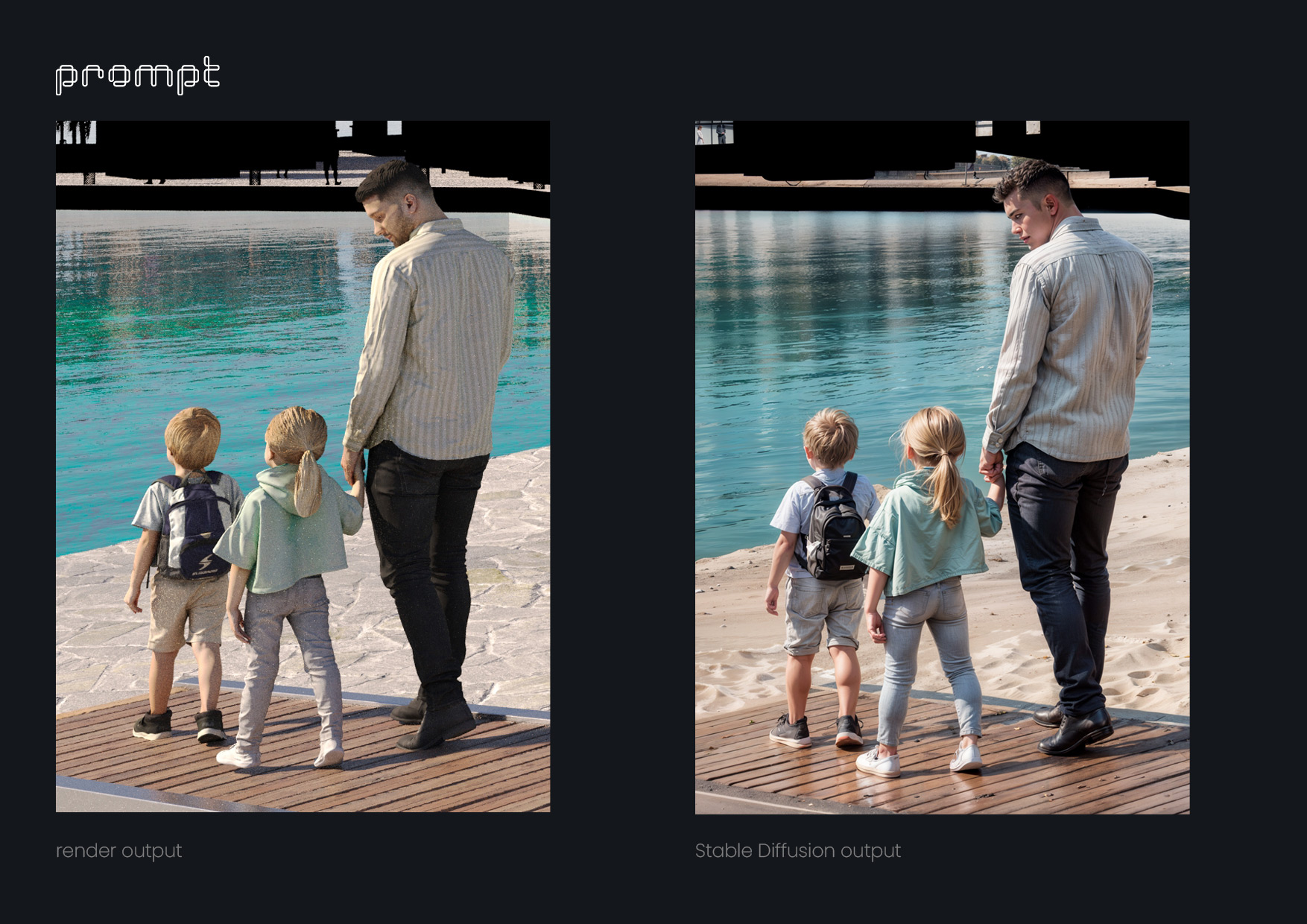

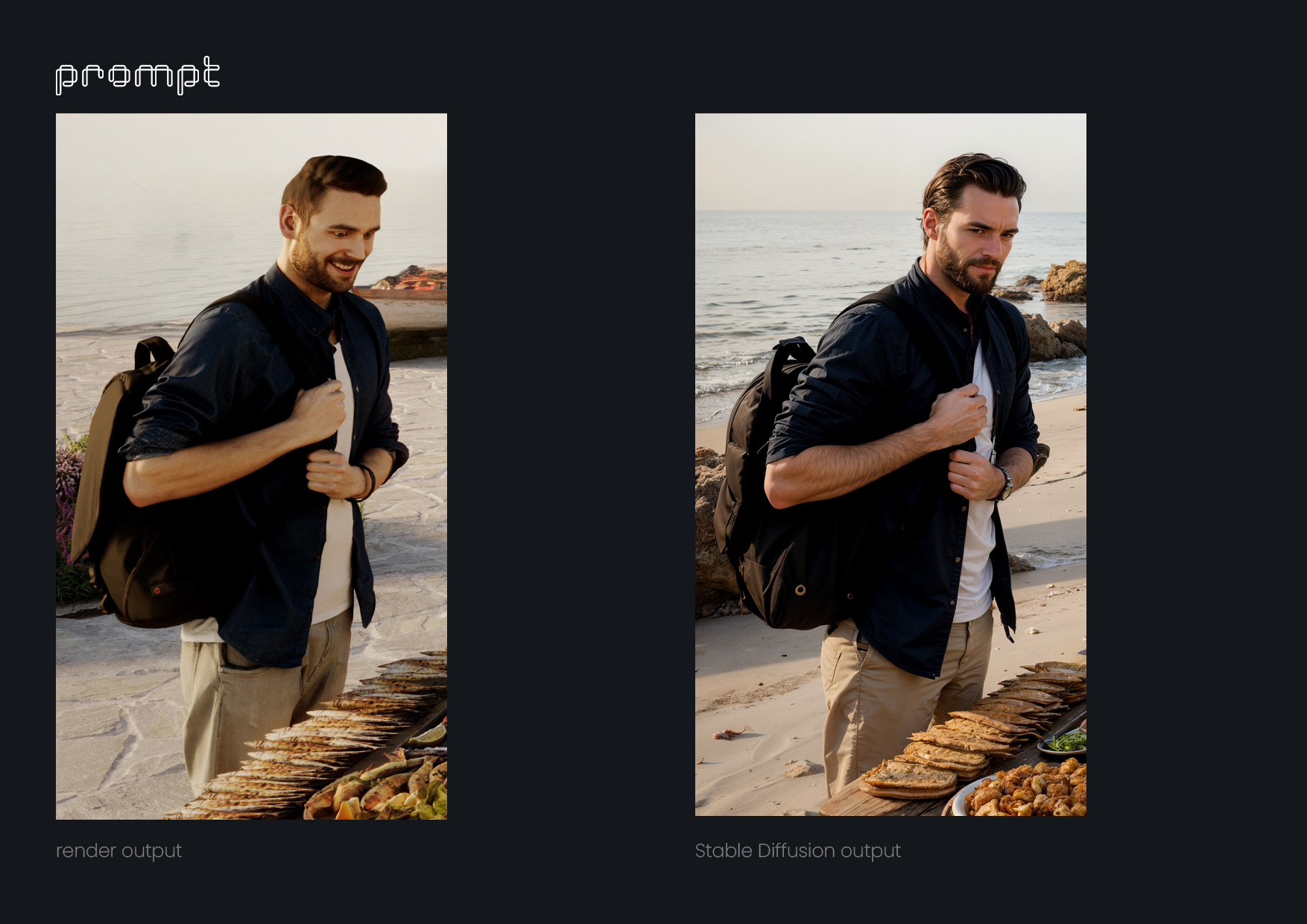

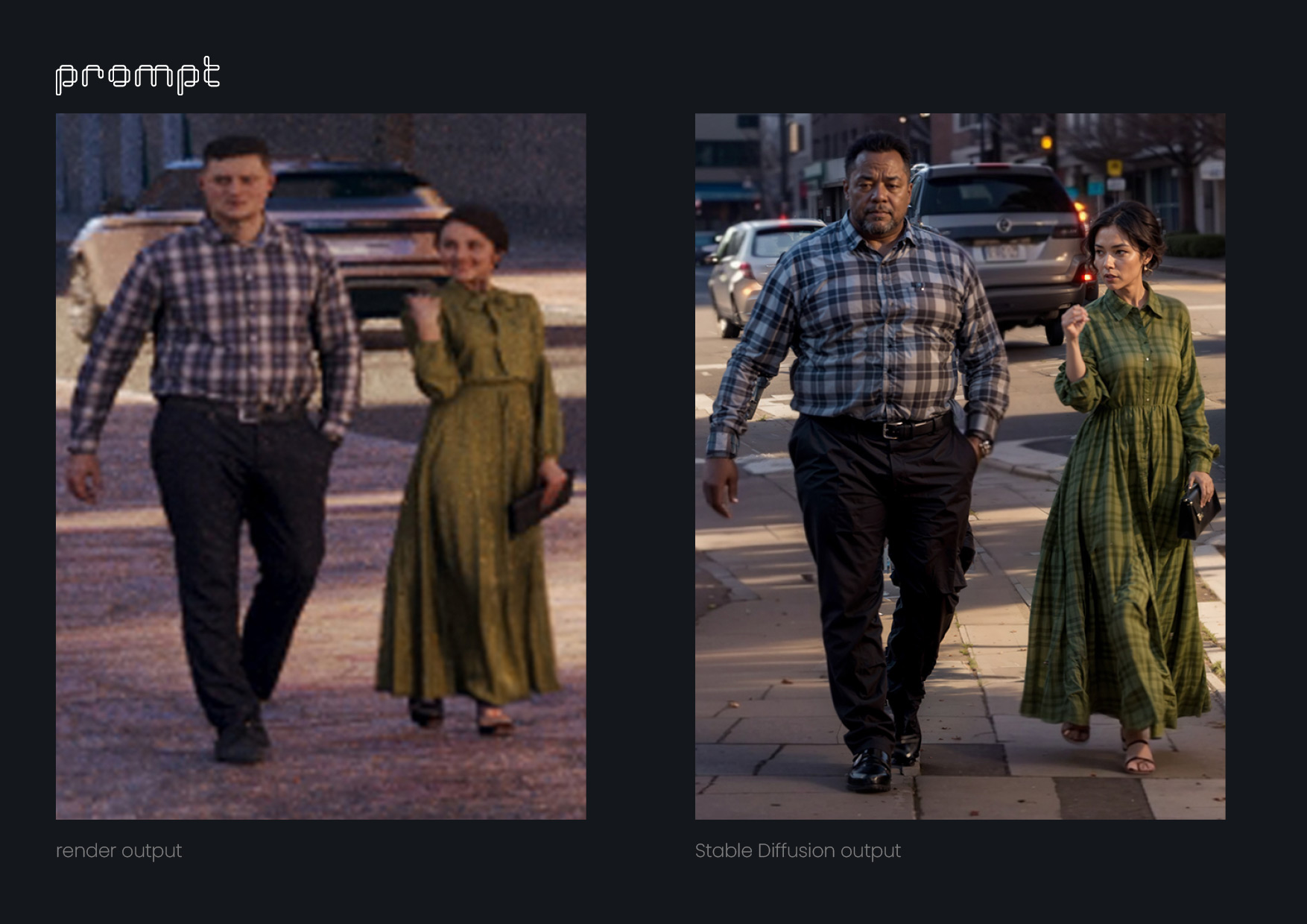

ALCUNI ESEMPI DI RENDERING AI-ENHANCED

SULL'ARTISTA

Lo studio creativo è un team affermato con sede a Barcellona con oltre un decennio di esperienza internazionale. Vantano un gruppo eterogeneo di professionisti provenienti da contesti e culture diverse, fornendo una prospettiva completa per i processi creativi e offrendo soluzioni visive su misura. Nel panorama globale altamente visivo di oggi, in cui le immagini fungono da linguaggio universale per promuovere idee e progetti, sono specializzati nella fornitura di rendering, animazioni, tour virtuali, brochure di vendita e siti Web di prim'ordine. Il loro flusso di lavoro efficiente ruota attorno alla comprensione della visione unica del cliente, al rispetto delle scadenze e alla presentazione di opzioni complete ed economicamente vantaggiose. I loro servizi principali comprendono rendering, animazioni, tour virtuali, brochure di vendita e siti Web.

Per metterti in contatto con loro, controlla le informazioni di contatto di seguito:

https://www.promptcollective.com/contact